A questão de como distribuir recursos nas economias e sociedades gera discussões entre economistas, filósofos e cientistas sociais há muito tempo. Agora, a Deepmind está explorando como a IA pode ajudar neste problema.

Imaginem um grupo de pessoas contribuindo para um fundo comum. Como o valor de um possível ganho poderia ser redistribuído entre eles? Alguém pode argumentar que o melhor é redistribuir igualmente, mas outro pode dizer que isto é injusto porque nem todos investiram o mesmo valor.

Então, um outro caminho seria redistribuir os ganhos com base no valor que cada um colocou inicialmente. Neste caso, podemos estar sendo injusto ao assumir que todos tinham as mesmas condições no ponto de partida. E existem mais caminhos possíveis.

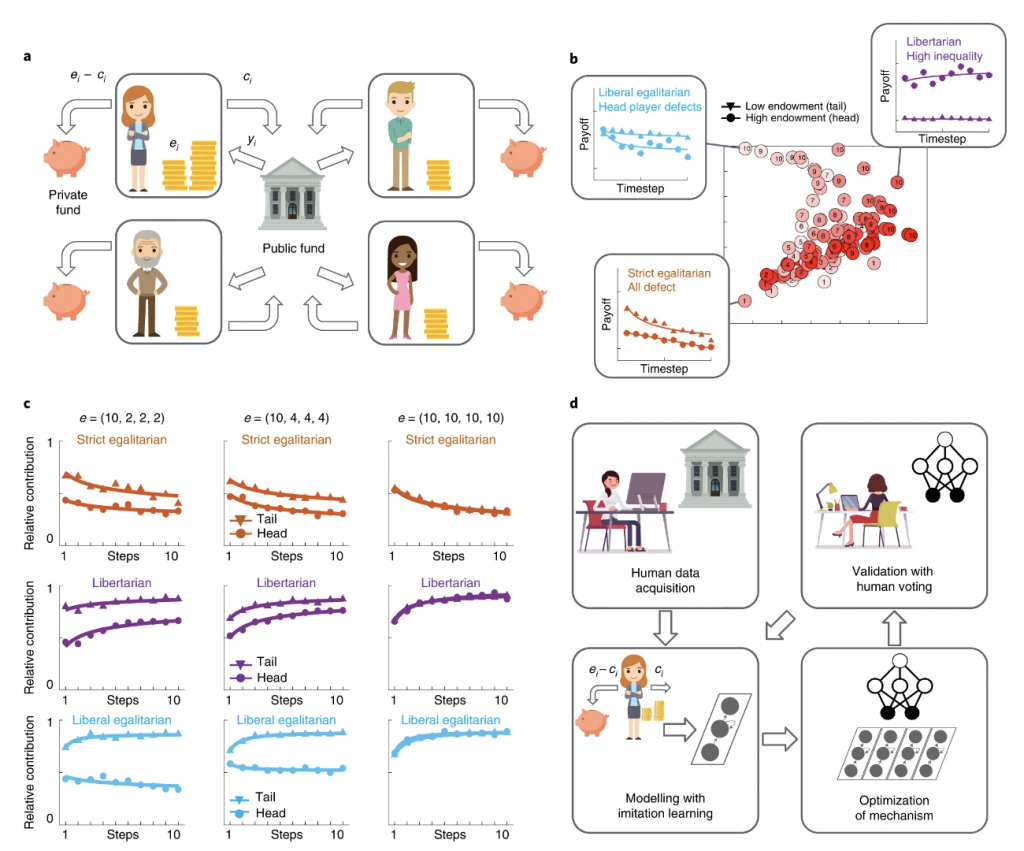

Na ciência, usamos muitos jogos econômicos que simulam situações deste tipo. Voluntários jogam, fazem suas escolhas, enquanto os coletamos dados para estudar o comportamento e preferencias das pessoas. Foi a partir de um jogo assim que a DeepMind treinou sua IA.

Os voluntários começaram o jogo com valores diferentes. A cada rodada eles podiam decidir o quanto investiriam no fundo e o quanto guardariam para si. Nas primeiras rodadas, um “juiz” decidiria como os recursos seriam redistribuídos; e nas subsequentes, outro.

No fim do jogo, eles votavam para o juiz “A” ou “B”, sendo que um deles era o modelo de IA, que acabou escolhido pela maioria.

A IA aprendeu um esquema de redistribuição que levava em consideração as condições desiguais nas quais os participantes começaram o jogo, além de punir os “free riders”.

Os resultados são interessantes. Um dos desafios da IA é garantir o “alinhamento de valores”, ou seja, que se comporte de acordo com a preferência dos humanos.

Mas para algumas questões sociais, isso é ainda mais difícil por não haver consenso entre os próprios humanos.

O diferencial deste projeto é que a IA não foi treinada com um conjunto de dados “de verdade fundamental”, tipicamente repleta de vieses. A IA foi treinada para aprender a maximizar as preferências das pessoas, o que pode ajudar a IA a aprender políticas menos injustas.

Este é apenas um experimento, em um ambiente controlado de um jogo econômico. Não devemos nos iludir com o solucionismo tecnológico. Existem outros questionamentos e riscos, como a não garantia de participação no processo de grupos minoritários e outras fontes de vieses.

No entanto, a pesquisa tem seu mérito ao mostrar que quando a IA otimiza para as preferencias humanas, pode se tornar uma ferramenta para AUXILIAR a inovação de políticas públicas. E essa abordagem pode ser uma alternativa adequada para entender as preferências na sociedade.

Recomendo a leitura do paper publicado na Nature Human Behaviour.